Aby Twoja strona firmowa skutecznie zarabiała w Google, roboty wyszukiwarki muszą skupić się na tym, co najważniejsze. Nie chcesz przecież, by marnowały czas na techniczne zaplecze, panele logowania czy błędy, które powinny zostać ukryte. Dlatego dowiedz się, co to robots.txt. Zobacz, jak go poprawnie stworzyć, by roboty omijały to, co zbędne, i szybciej trafiały do Twojej oferty.

Robots.txt – co to jest?

Co to robots.txt? To prosty plik tekstowy, który umieszcza się w głównym katalogu strony internetowej. To on informuje roboty wyszukiwarek (tzw. crawlery), które podstrony mogą odwiedzać, a których powinny unikać.

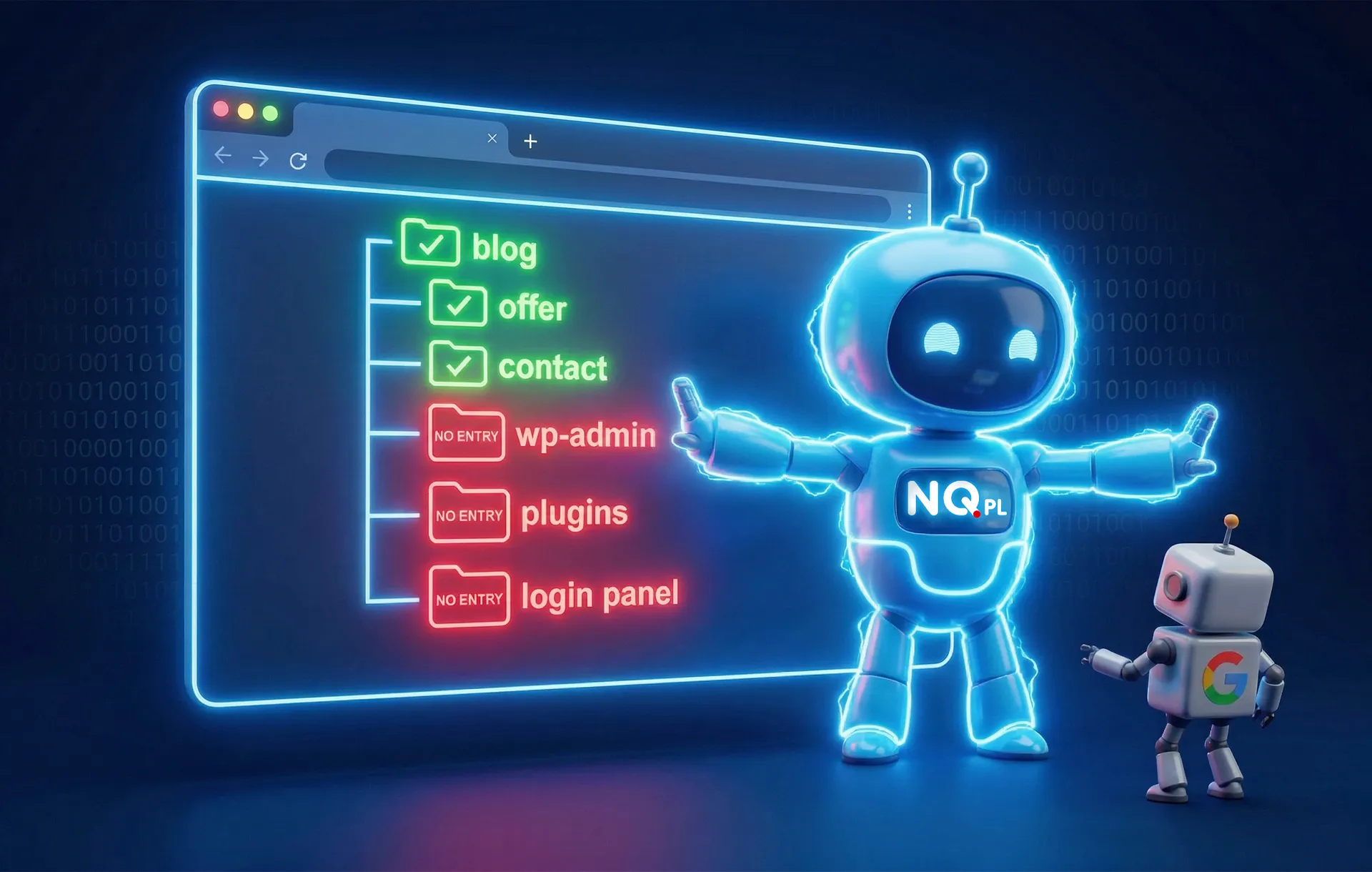

Co to jest robots.txt w praktyce? Kilka linijek kodu, które mówią botowi Google np., aby zaindeksował zakładki ofertowe i bloga, ale nie zaglądał do panelu administracyjnego. Takie zasady sprawiają, że roboty nie tracą czasu na podstrony nieistotne z punktu widzenia wyników wyszukiwania – a Twoja strona jest indeksowana sprawniej i bardziej „celnie”.

Ważne! Robots.txt nie ukrywa stron w sensie wyłączenia ich z dostępu. Jeśli ktoś zna adres URL, wciąż może wejść na tę stronę. Plik służy wyłącznie do zarządzania ruchem botów.

Jak powinien wyglądać plik robots.txt?

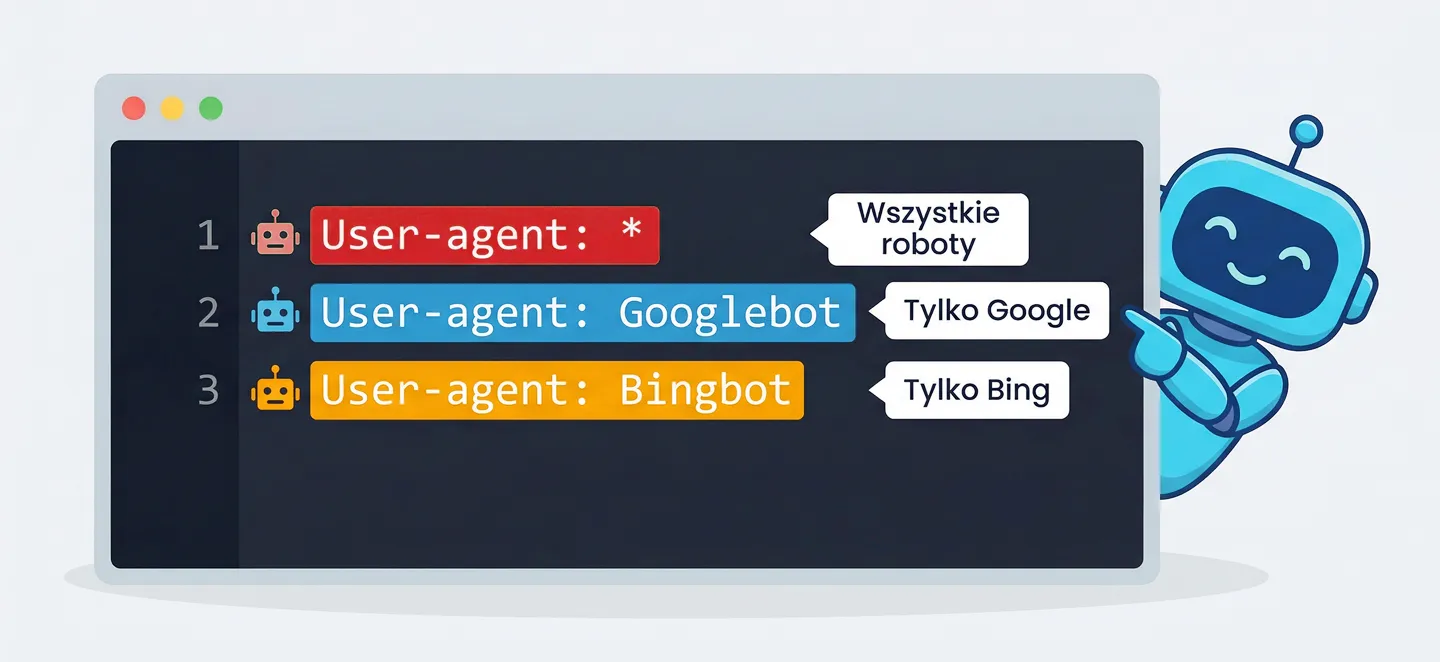

Jak powinien wyglądać plik robots.txt w najprostszej wersji? Wystarczą trzy elementy.

wskazuje, do którego bota kierujesz instrukcje (gwiazdka * oznacza „wszystkie roboty").

mówi, czego bot nie powinien indeksować.

wskazuje lokalizację mapy witryny, co ułatwia robotom znalezienie najważniejszych podstron.

Zatem jak powinien wyglądać plik robots.txt dobrze zoptymalizowanej strony firmowej? Przede wszystkim nie powinien być ani pusty, ani nadmiernie rozbudowany. Kilka precyzyjnych reguł w zupełności wystarczy.

Czytaj też: Co to jest SLA serwera i dlaczego to ważne?

Jak sprawdzić plik robots.txt?

Aby sprawdzić plik robots.txt, po prostu wpisz w przeglądarce adres swojej strony z dopiskiem /robots.txt – np.

twojastrona.pl/robots.txt.

Jeśli istnieje, zobaczysz jego zawartość.

A jak sprawdzić plik robots.txt pod kątem błędów? Skorzystaj z narzędzia Google Search Console. W zakładce „Tester pliku robots.txt" możesz wkleić jego treść i zweryfikować, czy nie blokujesz przypadkiem czegoś istotnego. To ważne, bo nawet jeden błąd w regule „Disallow" potrafi wyciąć z indeksu całe sekcje witryny!

Warto też zerknąć na pliki robots.txt konkurencji – to dobry sposób, żeby zobaczyć, jakie reguły stosują inne firmy w Twojej branży i zaczerpnąć z nich inspirację.

Jak stworzyć robots.txt, żeby spełniał swoje zadanie?

Zastanawiasz się, jak stworzyć robots.txt? Wystarczy otworzyć zwykły edytor tekstu (np. Notatnik), wpisać odpowiednie reguły i zapisać plik pod nazwą robots.txt. Następnie umieść go w katalogu głównym swojej strony, np. przez FTP lub menedżer plików w panelu hostingowym. Jeżeli korzystasz z WordPressa, możesz to zrobić jeszcze prościej – za pomocą wtyczki Yoast SEO lub All in One SEO, które pozwalają edytować plik bezpośrednio z poziomu panelu administracyjnego.

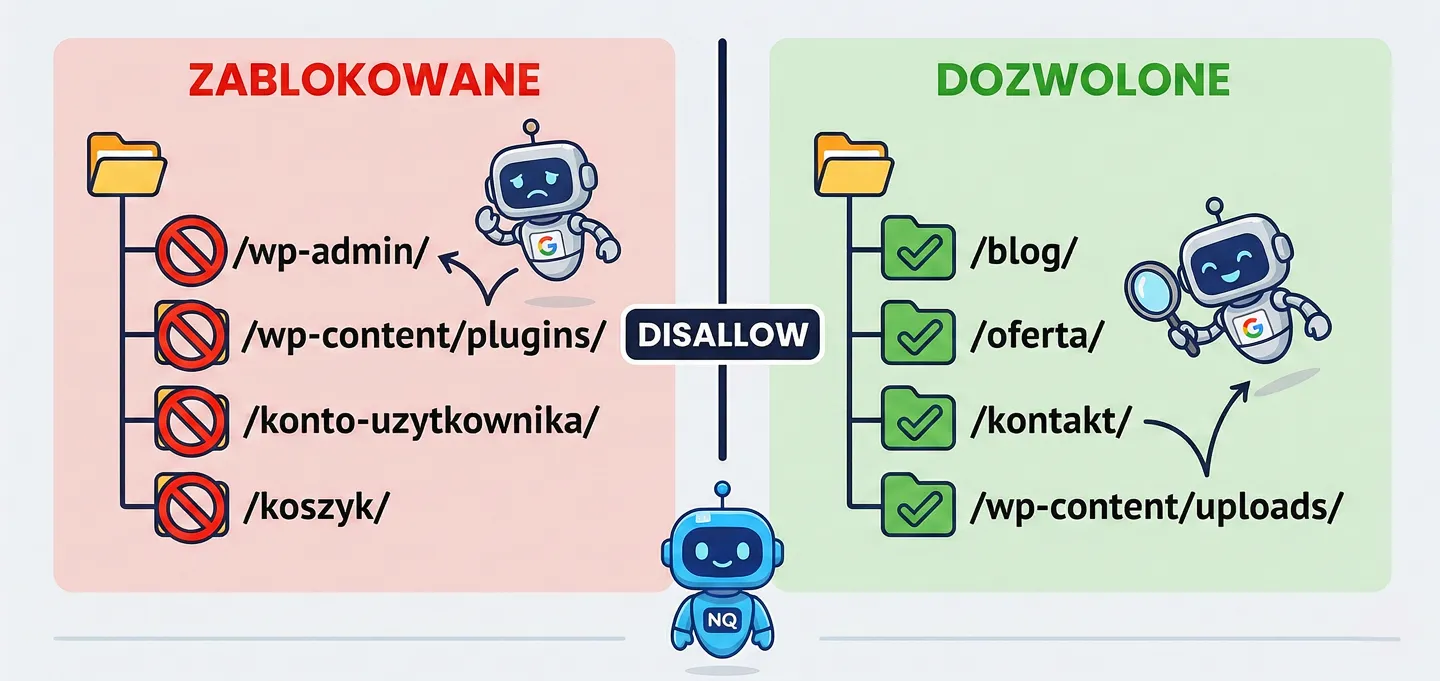

Jeżeli chcesz, aby robots.txt pomagał w dbaniu o bezpieczeństwo i dobre SEO:

zablokuj dostęp do katalogów technicznych, takich jak /wp-admin/ czy /wp-content/plugins/ – nie wnoszą nic do wyników wyszukiwania;

zezwól na crawlowanie katalogu /wp-content/uploads/ – jeśli dodajesz opisy i atrybuty alt do grafik, chcesz, żeby roboty je widziały;

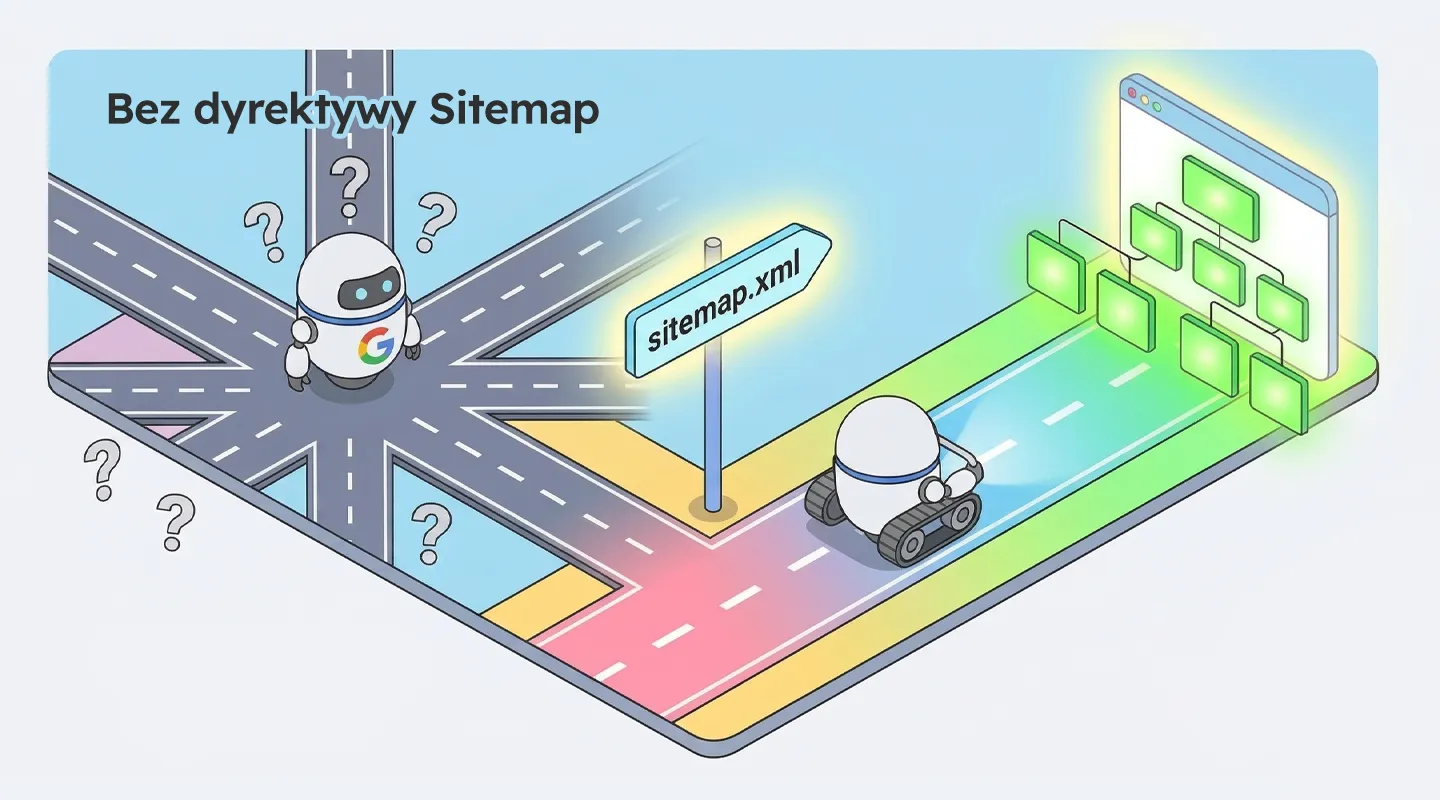

zawsze dodawaj link do mapy witryny (Sitemap) – to jak drogowskaz, który prowadzi crawlery prosto do najważniejszych podstron;

nie blokuj plików CSS i JavaScript – Google potrzebuje ich, żeby poprawnie renderować Twoją stronę i ocenić jej jakość;

Ważne! Każda subdomena wymaga osobnego pliku robots.txt.

Czytaj też: Wpływ serwera na szybkość strony www

Jak edytować robots.txt?

Edycja robots.txt jest potrzebna zawsze wtedy, gdy zmienia się struktura Twojej strony, np. dodajesz nowe sekcje, przenosisz katalogi albo zauważasz w Search Console, że Google indeksuje coś, czego nie powinien. Zatem jak edytować robots.txt?

- Jeśli korzystasz z wtyczki SEO w WordPressie, wystarczy wejść w jej ustawienia i zmienić reguły w dedykowanym edytorze.

- Bez wtyczki – pobierz plik z serwera przez FTP, edytuj go w Notatniku, zapisz i wgraj ponownie do katalogu głównego.

Pamiętaj! Przed każdą zmianą warto zrobić kopię zapasową aktualnej wersji pliku – jeden błąd w regule potrafi wyłączyć stronę z wyników wyszukiwania.

Potrzebujesz więcej informacji i szukasz rozwiązań, które wzmocnią SEO Twojej strony? Zapraszamy do kontaktu!